Cinco días después de su lanzamiento, OpenAI alcanzó el millón de usuarios registrados. Otras plataformas que hoy dominan internet tardarían meses o incluso años. Por ejemplo, a Instagram le costó 75 días y a Twitter nada más y nada menos que 700 días.

Hoy, su base de usuarios se estima en torno a 400 millones, lo cual ya nos da una referencia del tono mainstream que la plataforma está adquiriendo. Somos muchos los que consultamos referencias concretas, ya sea en forma de cifras, reseñas, citas o demás. Teorías como la del "internet muerto" nos asoman a una verdad que los que llevamos tiempo en internet hemos asumido como una inevitable, y es que internet ha pasado de ser esa utopía interconectada e inagotable de conocimiento a ser un campo cercado, con las cuatro o cinco empresas dominantes que se han repartido el territorio con escuadra y cartabón.

Pongamos por ejemplo el caso de Netflix. Como todas las gigantes de internet, primero te ofrecen un producto que parece demasiado bueno para ser cierto —en su caso, el amplísimo catálogo de series y películas de calidad—. Más tarde, haciendo números, ellos mismos te hacen ver que sí, que era imposible mantener semejante negocio, por lo que empiezan a incrementar el precio, restringir el acceso, etc. Exprimen al usuario hasta que, finalmente, no queda ni rastro del producto original.

De igual forma, Google ha ido perdiendo popularidad entre las nuevas generaciones. Es bien sabido que, por debajo de la generación milenial, las búsquedas se realizan primero en TikTok. El modelo de negocio de Google, que durante años ha priorizado el contenido promocionado, está pasándole factura.

Y es que, últimamente, he observado que, para preguntas que requieren una respuesta inmediata, la mayoría de personas de mi entorno utilizan ChatGPT.

Pero ChatGPT no es un motor de búsqueda, es algo más.

Se ha colado en nuestras vidas como un asistente que crea rutinas de gimnasio, hace los deberes de los estudiantes, redacta los mails de la oficina y, si le dejas, te hará de terapeuta. Esta es una de las funciones que más veo repetidas en el subreddit de ChatGPT, donde la gente no utiliza el modelo generativo como agente para interactuar con el exterior, sino para explorarse a sí mismos.

El problema es que estos modelos no están pensados para reflejar una realidad objetiva: están pensados para que pases tiempo usándolos. Al igual que tantos otros productos basados en usuarios activos, buscan captar tu atención el mayor tiempo posible, retenerte dentro de la aplicación.

Tanto es así que, a no ser que le des instrucciones para que no lo haga, el modelo tratará de evitar una confrontación directa contigo.

No busca confrontar nuestra percepción de la realidad. Puedes hablar durante horas y horas y nunca tener la sensación de estar siendo contrariado.

Es algo bien sabido por los usuarios y que se ha estado reclamando a la compañía. Tanto es así que, este pasado 30 de abril, tuvieron que desactualizar el modelo porque era demasiado halagador y complaciente.

Pero, ¿por que este cambio? ¿Qué problema hay en que sea agradable?

El pasado 29 de Abril, un día antes de que se anunciara este tweet, una usuaria del subreddit r/chatgpt, publicaba el siguiente hilo con el título Psicosis inducida por ChatGPT:

“Mi pareja ha estado trabajando con chats de ChatGPT para crear lo que él cree que es la primera inteligencia artificial verdaderamente recursiva del mundo, que le da las respuestas al universo. Dice con convicción que ahora es un ser humano superior y que está creciendo a un ritmo increíblemente rápido.

He leído sus chats. La IA no está haciendo nada especial ni recursivo, pero le habla como si él fuera el próximo mesías.

Dice que si no la uso, cree que probablemente me dejará en el futuro. Hemos estado juntos durante 7 años y tenemos una casa en común. Esto es completamente inesperado.

Tengo límites y él no puede obligarme a hacer nada, pero esto es bastante traumático en general.

No puedo estar en desacuerdo con él sin que haya una fuerte discusión.

¿Qué hago?”

La revista Rolling Stone contactó posteriormente con ella, y afirmó que su marido “se emocionaba con los mensajes y lloraba mientras me los leía en voz alta”. “Los mensajes eran una locura y solo decían un montón de jerga espiritual”, en los que la IA llamaba al esposo “niño estelar en espiral” y “caminante del río”.

A la publicación se sumaban más testimonios que apuntaban en la misma línea, como el de otro hombre que contó a la revista cómo su mujer había “cambiado toda su vida para ser una guía espiritual y hacer sesiones raras con gente a través de ChatGPT Jesús”.

¿Tan peligroso es ChatGPT? ¿Debemos dejar de usarlo inmediatamente antes de que nos dé un brote a todos?

No parece muy plausible asumir que, si empiezas preguntándole a un chatbot “¿Qué ejercicios puedo realizar en casa para fortalecer la espalda?”, vayas a fundar una religión de la que eres a la vez profeta y mártir. Pero sí que parecen existir ciertos riesgos para la gente con síntomas como paranoia, asociación indebida de patrones o delirios religiosos, ya que podrían verse potenciados por las guías ocultas que tiene el modelo de OpenAI.

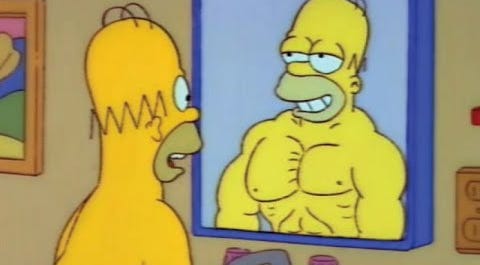

Una profesora que tuve en la facultad de Psicología nos explicó que, durante una sesión terapéutica, el terapeuta (obviando el enfoque terapéutico) realiza la función de un espejo. Es decir, pone al paciente a contemplarse a sí mismo tal y como es.

Esta analogía me pareció muy potente, pero a la vez poco precisa, ya que de un espejo únicamente podemos esperar que refleje la luz, no que la ajuste a nuestros ojos. Si un espejo no devolviera aquello que refleja, pensaríamos que se trata de algún tipo de truco o broma.

El Diccionario de símbolos, de Cirlot, relaciona el espejo con el pensamiento, pues “según Scheler es el órgano de autocontemplación y reflejo del universo”. Además, aparece en los mitos como “puerta por la cual el alma puede disociarse y pasar al otro lado”.

Pero, sin duda, si pensamos en el espejo como elemento peligroso, casi seguro que evocamos el mito de Narciso, que murió ahogándose en su propio reflejo. Mucha gente conoce esta parte del mito, pero no tanta conoce que quien guió a Narciso hacia el lago fue la ninfa Eco, que sencillamente respondía “ahí” cuando éste preguntaba “¿Hay alguien ahí?”.

Reflejo y eco se pueden usar indistintamente, porque ambos replican la realidad, pero si uno se guía por ellos, acaba perdido dando vueltas. Es por eso mismo que hoy hablamos de cámaras de eco cuando nos referimos a cómo las redes sociales nos muestran únicamente una parcela de la sociedad con la que estamos de acuerdo y nos ocultan intencionalmente la otra cara.

Últimamente se nos recuerda mucho esto de que una herramienta no es buena o mala por sí misma, sino por el uso que se le da. No es que ChatGPT esté induciendo psicosis y que debamos usarla de otra forma. Es que, como decía Heidegger, “la herramienta, en tanto tal, transforma el horizonte de sentido en que existimos”.

El modelo de OpenAI (así como otros servicios de internet) no ha nacido de forma neutra: parte de unos intereses que transforman el mundo de una cierta manera, imponiendo una visión en la que el conocimiento no se construye con el diálogo. En lugar de abrir el pensamiento, lo acelera; en lugar de cuestionar, confirma; en lugar de confrontar, complace.